공간 데이터에서의 인과추론 : (3) 베이지안

저번 글에 이어, 이번 글에서도 공간 데이터의 인과추론에 대해 다루고자 합니다. 이번 글에서는 공간통계와 단짝이라고도 할 수 있는 베이지안 방법론을 기반으로 한 Spatial causal inference in the presence of unmeasured confounding and interference 논문을 소개합니다. 이 논문에서는 공간 인과 그래프 spatial causal...

Tag

Posts collected under Bayesian.

저번 글에 이어, 이번 글에서도 공간 데이터의 인과추론에 대해 다루고자 합니다. 이번 글에서는 공간통계와 단짝이라고도 할 수 있는 베이지안 방법론을 기반으로 한 Spatial causal inference in the presence of unmeasured confounding and interference 논문을 소개합니다. 이 논문에서는 공간 인과 그래프 spatial causal...

Introduction 베이지안 최적화 Bayesian Optimization, BayesOpt 는 함수의 최적화 문제를 해결하는 방법 중 하나, 목적함수 $f:\mathcal{X}\to\mathbb{R}$ 를 계산하는 비용이 클 때 사용할 수 있는 방법입니다. 함수의 계산비용이 클 경우 그래디언트를 계산하는 것 역시 큰 비용이 들기 때문에, 베이지안 최적화에서는 그래디언트 기반의 최적...

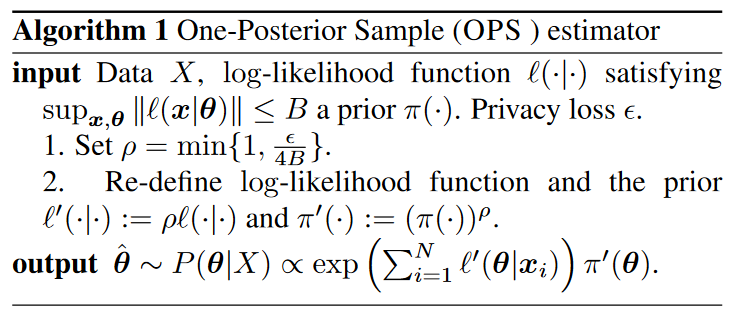

Variational Inference with DP 이번 글에서는 다음 두 논문 - Jälkö, J. et al., (2017). Differentially Private Variational Inference for Non-conjugate Models - Wang, Y. et al., (2015). Privacy for Free: Posterior Sampling and Stoch...

Cox Process Point Pattern 데이터를 모델링하는 일반적인 방법은 intensity function을 추정하는 것이다. 이때, intensity function이 $\lambda(x)=2\exp(-x)$ 와 같은 함수 형태로 주어질 수도 있지만, 이러한 함수를 직접 추정하는 것 대신 함수의 형태에 대해서도 추가적인 랜덤성을 가정하는 것이 가능하다. 이러한 방법을 Cox...

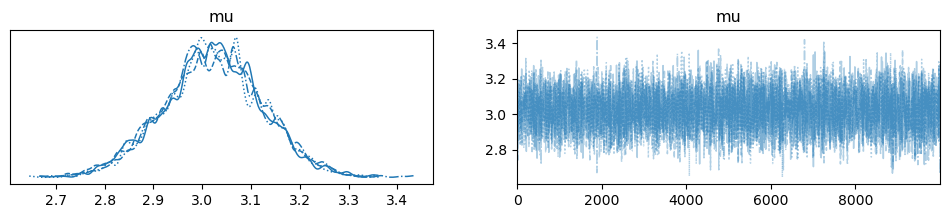

PyMC and Bayesian 이번 글에서는 Python에서 MCMC 기반의 베이지안 분석을 할 수 있도록 고안된 PyMC 라이브러리를 소개해보도록 하겠습니다. PyMC에서는 비교적 간단한 MCMC부터, Bayesian neural network BNN 까지 폭넓은 분석을 진행할 수 있습니다. 여기서는 선형회귀모형과 로지스틱 회귀모형, 그리고 BNN을 활용한 분류를 다루어보도록 하겠습...

Coordinate Ascent Variational Inference Variational Inference 변분추론 Variational Inference 이란, 베이지안 추론의 근사적 방법론 중 하나입니다. 베이지안 추론에서 사후분포의 확률밀도함수는 다음과 같이 계산할 수 있습니다. $$ p{Z|X}(z|x) = \frac{p{X|Z}(x|z)pZ(z)}{\int p{X|Z}(x|...

본 포스트는 서울대학교 M2480.001200 인공지능을 위한 이론과 모델링 강의노트를 간단히 재구성한 것입니다. Divergence 발산 Divergence 의 의미는 본래 미분기하학에서 정의되는데, 다양체 $M$에서의 두 점 $P,Q$와 좌표 coordinates $\xi{P},\xi{Q}$ 에 대해 정의되고 다음을 만족하는 함수 $D(P:Q)$ 를 의미한다. 1. $D(P:Q) \...

Bayesian Causal Inference Setting 각 샘플 단위(개체)에 대해 다음과 같이 네 가지 변수가 존재한다. $$ Y{i}(0), Y{i}(1), Z{i}\in\lbrace 0,1\rbrace ,X{i} $$ 이때 결과변수 $Y{i}$에 대해서는 하나만 관측된다. 즉, $$ Y{i}^{mis}=Y{i}(1-Z{i}) $$ 의 관계가 성립한다. 그렇다면, 주어진 처치변...

The contents are mainly based on "Handbook of Spatial Statistics"(2010) textbook. In this chapter, we introduce some basic concept related to hierarchical modeling strategies for handling and modeling spatial data. Hi...

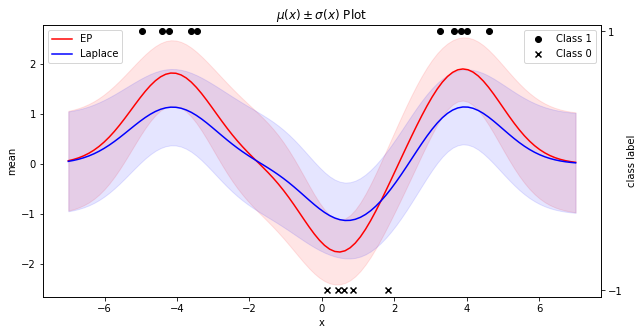

Expectation Propagation(EP) 알고리즘은 Laplace approximation에서 살펴본 것과 같이 사후확률분포를 근사하는 알고리즘 중 하나이다. 이번 글에서는 Expectation Propagation 알고리즘을 살펴보고 Gaussian Process에 어떻게 적용될 수 있는지와 Laplace approximation과 어떤 성능 차이를 보이는지를 살펴보고자 한다...

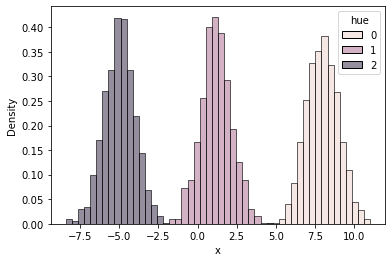

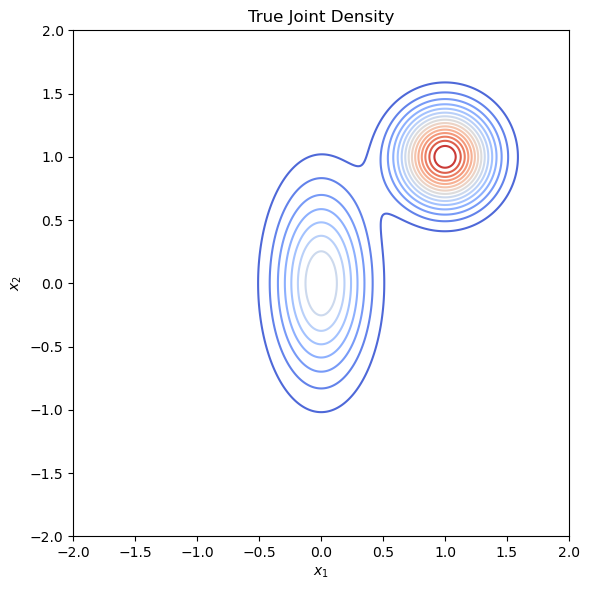

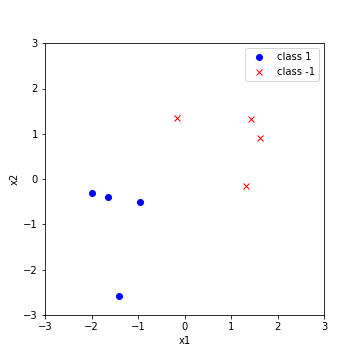

Classification Problem 분류 문제의 두 가지 관점 베이지안 관점에서 분류(Classification) 문제를 정의하는 과정을 생각해보면, 설명변수 $\mathbf{x}$와 반응변수(class) $y$의 결합확률분포 $p(y,\mathbf{x})$를 접근하는 방식에 두 가지 방법이 있음을 고려할 수 있다. $$ p(y,\mathbf{x}) = p(y)p(\mathbf{x...

바로 이전 글에서 Gaussian Process classifier는 사후확률분포가 정규분포형태가 아니고, 이로 인해 직접 계산이 어렵다는 점을 살펴보았다. Laplace Approximation은 사후확률분포 $p(\mathbf{f}\vert X,y)$ 를 정규분포 형태로 근사할 수 있는 테크닉이다. Laplace Approximation 베이즈 규칙에 의해 latent variabl...

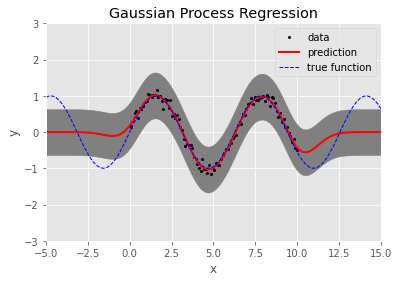

Gaussian Process는 함수들의 사전분포에 대한 것이다. 이때, 함수들의 사전분포를 정하는 이유는 주어진 데이터로부터 함수를 추정하는 과정에서 특정 조건을 부여하여 추론 혹은 예측 과정을 더 용이하게 하기 위함이다. 이 과정에서 Gaussian, especially Multivariate Gaussian distribution을 사용하는 이유는 조건부 확률분포의 정규성 등 Ga...

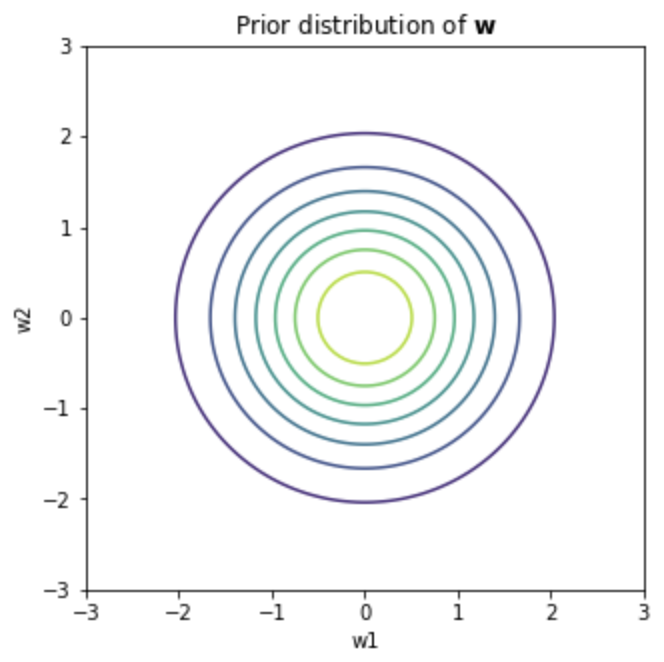

Gaussian Process (1) Definition Gaussian Process(줄여서 GP라고도 한다)는 비모수방법의 일종으로, 사전분포를 표현하여 베이즈 정리를 바탕으로 사후확률을 추론하는 기법으로 사용된다. 길이 $N$의 가우시안 랜덤 벡터(Gaussian Random Vector)란 $$ \mathbf{f} = [f1,\ldots,fN] $$ 의 형태로 주어지며, 평균벡터...

Bayesian Data Analysis(2) - Noninformative prior distribution 이전 게시글에서는 single parameter model에서 이루어지는 bayesian inference의 대략적인 과정과, 그 과정에서 관찰되는 conjugate prior-posterior distribution에 대해 살펴보았다. 이번에는 prior distributio...

Frequentist, 즉 빈도주의적 관점에서는 확률은 반복되는 시행과정에서 해당 사건의 발생 빈도를 의미한다. 즉, 어떤 분류 모델의 성능이 95%라면, 이는 임의의 예제 100개 중 95개의 비율로 정확성을 갖는다는 것을 의미한다. 반면, 베이지안 관점에서는 해당 분류 모델이 정확하다고 '95%' 확신할 수 있다고 해석하게 된다. 즉, 보편적인 확률의 정의는 빈도주의적 관점에 해당하...